ChatGPT'ye karmaşık bir matematik problemi verdiğinizde bazen hemen cevap veriyor, bazen de sanki düşünüyormuş gibi adım adım açıklama yapıyor. İşte bu ikincisi, yapay zekanın "Chain of Thought" (düşünce zinciri) diye adlandırılan bir yöntemi kullandığı anlamına geliyor. Peki bu tam olarak nedir? Ve neden AI modelleri için bu kadar önemli?

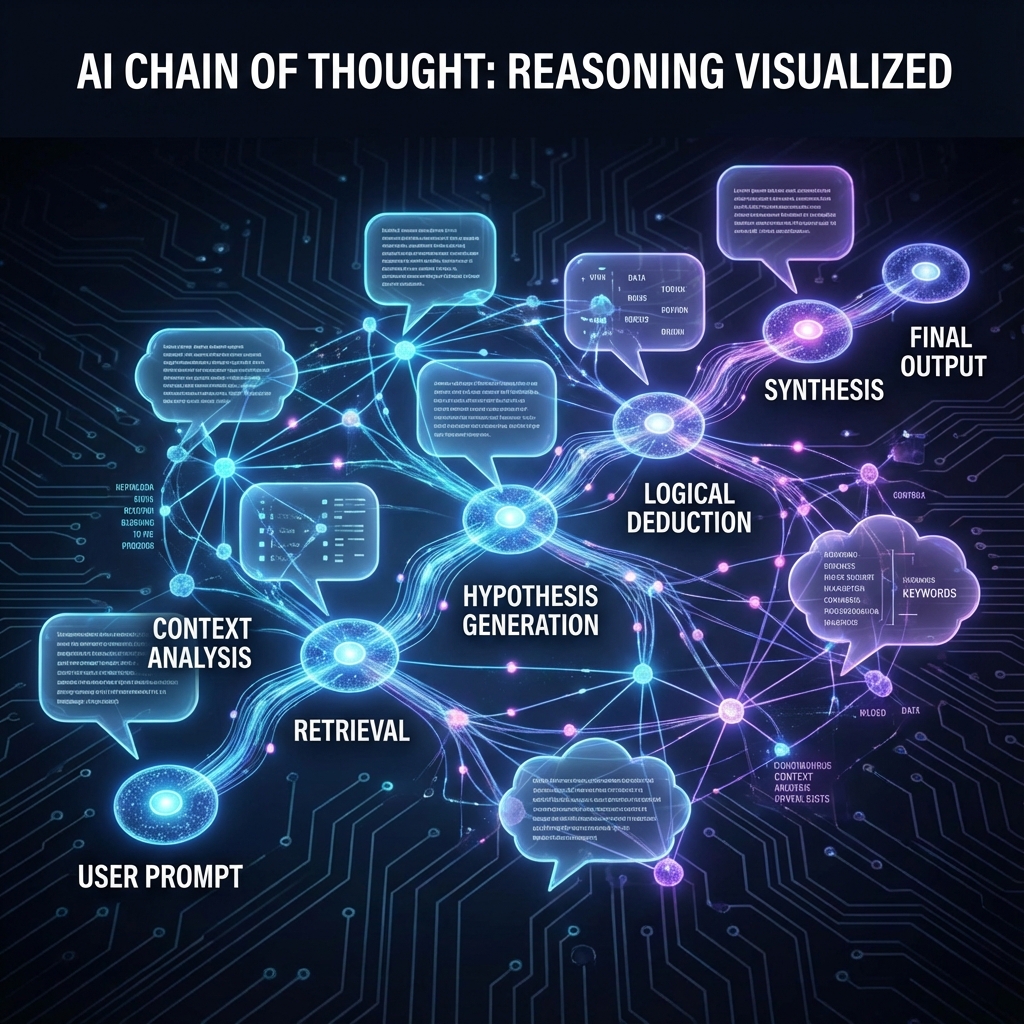

Chain of Thought, basitçe söylemek gerekirse yapay zekanın bir problemi parçalara ayırıp adım adım çözmesi demek. Tıpkı bizim kafamızda bir problemi düşünürken "önce şunu yapalım, sonra bunu" diye ilerlememiz gibi. Ama neden AI bunu yapıyor? Aslında, insan beyni gibi çalışmaya çalışıyor.

Chain of Thought Nasıl Ortaya Çıktı?

2022'ye kadar büyük dil modelleri (GPT-3 gibi) genelde direkt cevap veriyordu. Bir soru soruyordunuz, model hemen cevabı söylüyordu. Bazen doğru, bazen yanlış. Ama özellikle karmaşık matematik, mantık veya çok adımlı problemlerde bu modeller sık sık hata yapıyordu. Çünkü "düşünmüyorlardı" aslında—sadece tahmin ediyorlardı.

Google'ın araştırmacıları bir şey fark etti: Eğer modele sadece "cevap ver" deme k yerine "düşünce sürecini göster" dersen, doğruluk oranı inanılmaz artıyor. İlk Chain of Thought makalesi 2022'de yayınlandığında herkes şaşırdı. Basit bir prompt değişikliğiyle modelin performansı %50-60 artıyordu bazı görevlerde.

Nasıl mı? Şöyle: Normalde "12 x 15 kaç yapar?" diye sorduğunuzda, model direkt "180" der. Ama "Önce 12 x 10'u hesapla, sonra 12 x 5'i hesapla, sonra ikisini topla" derseniz, model adım adım gidiyor ve daha az hata yapıyor. İşte Chain of Thought'un temeli bu.

Neden Bu Kadar Etkili?

Chain of Thought'un etkili olmasının birkaç nedeni var. İlk olarak, büyük dil modelleri temelde "pattern matching" (desen eşleştirme) yapıyor. Eğitim sırasında milyarlarca metin görmüşler ve bunlardan kalıplar öğrenmişler. Ama karmaşık bir problemi tek adımda çözmek için gerekli "kalıp" her zaman eğitim verisinde olmayabiliyor.

Ancak problemi küçük adımlara bölünce, her küçük adım için model eğitim verisinde benzer örnekler bulabiliyor. Düşünün, "İstanbul'dan Tokyo'ya gitmek için ne yapmalıyım?" sorusunu direkt cevaplamak zor. Ama "Önce pasaport çıkar, sonra uçak bileti al, sonra vize işlemlerini yap" diye adımlara bölünce her adım daha basit hale geliyor.

İkinci olarak, Chain of Thought modelin "hatalarını görmesini" sağlıyor. Adım adım ilerlerken, bir adımda hata yaparsa bir sonraki adımda bunu fark edebiliyor. Direkt cevap verme modunda ise hata fark edilmeden cevap verilmiş oluyor.

OpenAI'ın o1 Modeli: Chain of Thought'un Zirvesi

2024 yılında OpenAI, "o1" adında yeni bir model ailesini tanıttı. Bu modelin en önemli özelliği: yerleşik Chain of Thought. o1 modeli, her zor problemi otomatik olarak düşünce zincirleriyle çözüyor. Hatta bazı problemlerde dakikalarca "düşünebiliyor" gerçek bir insan gibi.

OpenAI CEO'su S am Altman, o1 modelini tanıtırken "bu model, GPT-4'ten çok daha farklı bir şekilde düşünüyor" demişti. Ve gerçekten de öyle. o1, sadece hızlı cevap vermiyor—problemin üzerinde kafa yoruyor, farklı yaklaşımlar deniyor, mantıklı bir çözüme ulaşmaya çalışıyor.

Özellikle matematik, fizik, kimya ve programlama gibi alanlarda o1'in performansı inanılmaz. Üniversite seviyesi matematik sorularını çözebiliyor, karmaşık kodlama problemlerinde GPT-4'ten kat be kat daha başarılı. Hatta bazı akademik sınavlarda insan ortalamasını geçmiş durumda.

Günlük Hayatta Nasıl Kullanılıyor?

Chain of Thought sadece akademik bir kavram değil. Günlük hayatta pek çok farklı alanda kullanılıyor. Örneğin, bir ChatGPT kullanıcısıysanız ve karmaşık bir proje planı yapıyorsanız, modelin "adım adım planla" dediğinizde çok daha iyi sonuç verdiğini fark edeceksiniz.

Bir başka örnek, veri analizi. Bir şirkette çalışıyorsunuz ve satış verilerini analiz etmeniz gerekiyor. Direkt "analiz et" deme k yerine "Önce veriyi temizle, sonra trendleri bul, sonra sonuçları yorumla" derseniz, AI çok daha tutarlı ve anlamlı sonuçlar veriyor.

Yazılımcılar da Chain of Thought'tan faydalanıyor. Bir kod yazdırırken "direkt kodu yaz" demek yerine "problemin mantığını açıkla, sonra pseudocode yaz, sonra gerçek kod yaz" diyerek çok daha temiz ve hatasız kod alabiliyorlar.

Hangi AI Modelleri Chain of Thought Kullanıyor?

Bugün neredeyse tüm büyük dil modelleri Chain of Thought'u destekliyor. ChatGPT (GPT-4), Claude, Gemini—hepsi bu yöntemi kullanabiliyor. Ama bazı modeller bunu daha iyi yapıyor. Özellikle OpenAI'ın o1 modeli ve Anthropic'in Claude'u, Chain of Thought konusunda çok güçlü.

Google'ın Gemini 3.0'ındaki "Deep Think" modu da bir tür Chain of Thought. Model, karmaşık problemlerde otomatik olarak daha derine inip adım adım düşünüyor. Microsoft'un Copilot'u da benzer şekilde kullanıcıya düşünme sürecini gösteriyor.

Ama dikkat: Chain of Thought sadece büyük modellerde etkili. Küçük modeller (örneğin birkaç milyar parametreli) Chain of Thought ile bazen daha da kötü sonuç verebiliyor. Çünkü bu modeller adım adım düşünürken mantıksız zincirler oluşturabiliyor. Genelde 100 milyar parametre üstü modeller Chain of Thought'tan gerçekten fayda görüyor.

Prompt Engineering'de Chain of Thought

Eğer AI ile çalışıyorsanız, prompt engineering (istem mühendisliği) diye bir kavramı duymuşsunuzdur. Bu, AI'ya nasıl soru sorduğunuz ve ne istediğinizi nasıl formüle ettiğiniz demek. Chain of Thought, prompt engineering'in en güçlü tekniklerinden biri.

Basit bir örnek: "Bu metin hangi dilde?" diye sorarsanız, model direkt cevap verir. Ama "Önce metindeki harflere bak, sonra dil bilgisi özelliklerini analiz et, sonra hangi dilde olduğuna karar ver" derseniz, çok daha doğru sonuç alırsınız.

Bir başka taktik, "Zero-shot CoT" denen yöntem. Bu yöntemde hiç örnek vermeden modele sadece "adım adım düşün" diyorsunuz. Şaşırtıcı şekilde, bu basit ifade bile modelin performansını artırıyor. Sanki model, "aa tamam, bu problemde daha dikkatli olmalıyım" diye anlıyor.

Chain of Thought'un Sınırlar ı

Tabii ki Chain of Thought mükemmel değil. Bazı sınırlamaları var. İlk olarak, daha uzun cevap üretmek demek, daha fazla hesaplama gücü ve daha uzun bekleme süresi demek. Eğer hızlı bir cevap istiyorsanız, Chain of Thought bazen gereksiz olabiliyor.

İkincisi, her zaman işe yaramıyor. Basit sorularda Chain of Thought gereksiz. "Bugün hava nasıl?" gibi basit bir soru için adım adım düşünmeye gerek yok. Hatta bazen bu, modelin kafasını karıştırabiliyor.

Üçüncüsü, bazen yanlış düşünce zincirleri oluşabiliyor. Model, ilk adımda yanlış bir varsayımda bulunursa, sonraki tüm adımlar da yanlış oluyor. Bu durumda Chain of Thought, hatayı büyütüyor.

Gelecekte Chain of Thought

Yapay zekanın geleceğinde Chain of Thought çok daha merkezi bir rol oynayacak. Çünkü AGI'ye (Artificial General Intelligence) ulaşmak için AI'ların karmaşık problemleri çözebilmesi şart. Ve karmaşık problemler, çok adımlı düşünme gerektiriyor.

OpenAI, Google, Anthropic—hepsi Chain of Thought'u geliştirmek için çalışıyor. Gelecekte AI modelleri, sanki bir bilim insanı gibi saatlerce bir problem üzerinde kafa yoracak, hipotezler kuracak, test edecek ve sonuca ulaşacak. Bu, "slow thinking" (yavaş düşünme) de niyor ve yapay zekanın son sınırlarından biri.

Bir başka gelişme alanı, "Tree of Thoughts" (düşünce ağacı). Bu yöntemde AI sadece tek bir düşünce zinciri oluşturmuyor, birden fazla farklı yaklaşım deniyor ve en iyi sonucu seçiyor. Sanki paralel evrenlerde aynı problemi farklı şekillerde çözüp en iyi çözümü seçiyorsun uz gibi.

Sonuç: İnsanın Düşünme Yöntemi, AI'ın Gücü

Chain of Thought, yapay zekanın insan gibi düşünmeyi öğrenmesinin bir yolu. Biz insanlar da karmaşık problemleri adım adım çözüyoruz. İşte AI de aynısını yapıyor artık. Bu basit ama güçlü bir fikir ve yapay zeka devriminin temel taşlarından biri.

Eğer siz de ChatGPT, Claude veya başka bir AI kullanıyorsanız, bir deneyin: Karmaşık bir soruyu "adım adım düşün" diye sorun. Farkı göreceksiniz. Yapay zeka, düşünmeyi öğrendi. Ve bu, her şeyi değiştiriyor.

Chain of Thought, yapay zekanın sadece tahmin etmekten çıkıp gerçekten akıl yürütmeye başladığı an. Ve bu an, şu anda yaşanıyor. 🚀